Tiempo de lectura aprox: 3 minutos

- El uso de la IA Grok en la red social Twitter, ahora llamada X, para alimentar disputas políticas está distorsionando su potencial y podría convertirla en un vehículo para la desinformación y la polarización

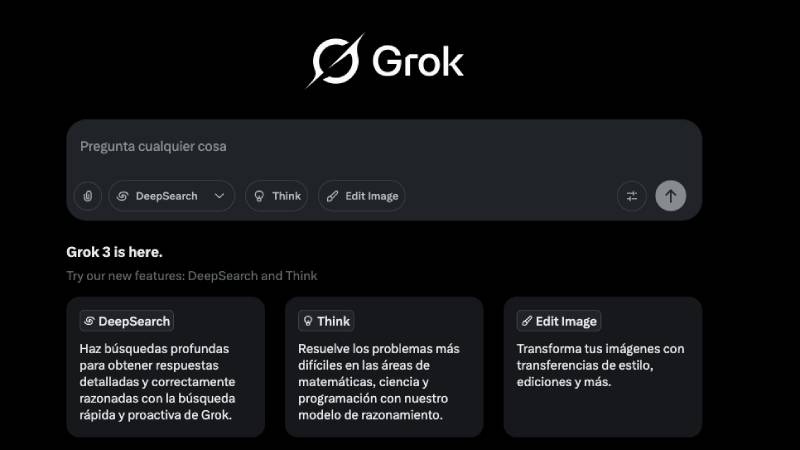

Siempre he sido un promotor de que la tecnología nos debe ayudar a dar el siguiente paso, y ahora con la IA, pensé que podíamos potenciar la capacidad de entender y dejar tareas repetitivas para las máquinas y dedicarnos a entender nuestro entorno y crear más. Sin embargo, esta semana he sido testigo de un fenómeno preocupante: el uso de la IA Grok en la red social X (anteriormente Twitter) para alimentar disputas políticas.

En lugar de utilizar esta poderosa herramienta para el bien común, los usuarios están generando prompts sesgados a sus ideologías o intereses, casi como un “Pedid y se os concederá”.

Los llamados chairos y derechairos están enfrascados en una “lucha” por ver qué contestaba la IA Grok, con tal de descalificar los dichos de unos y otros. Este uso distorsionado de la IA no solo es un desperdicio de su potencial, sino que también es un preámbulo de un problema mayor: la IA podría convertirse en un vehículo para la desinformación y la polarización.

Desde la llegada de ChatGPT, pasando por Gemini, Copilot, hasta las más recientes como DeepSeek y Grok, cada una de estas IA se alimenta de la información generada por los usuarios para ir creando su base de datos y poder generar el contenido que le sea solicitado. Esto significa que entrenamos a la IA con nuestros intereses, textos y búsquedas, por lo que siempre darán los resultados que nosotros queremos, es decir, nuestra verdad, sin que esa necesariamente sea la realidad.

El problema radica en que, al adecuar la IA a nuestros intereses, estamos creando un ciclo de retroalimentación que refuerza nuestros sesgos y prejuicios. Un estudio reciente reveló que el 62% de los usuarios de redes sociales han sido expuestos a información sesgada debido a algoritmos de IA.

Esto no solo afecta la percepción pública, sino que también puede tener consecuencias graves en la toma de decisiones políticas y sociales.

Poner una IA en Twitter, por cierto, una de las redes sociales con más peleas, fue en un principio una forma de ayudar a Elon Musk a entrenar a su IA. Sin embargo, conforme han pasado los días, lo único que ha quedado claro es que la inteligencia artificial para muchos no es una herramienta, sino un juguete.

En lugar de utilizarla para mejorar nuestras áreas de oportunidad y dominarla para beneficios laborales o educativos, estamos permitiendo que se convierta en un arma de desinformación.

Necesitamos que cambiemos nuestra perspectiva y comencemos a entrenar a la IA para que nos muestre cómo trabajar en nuestras áreas de oportunidad. Debemos enfocarnos en utilizar la IA para el bien común, promoviendo la educación y el desarrollo profesional. Solo así podremos aprovechar su verdadero potencial y evitar que se convierta en un mero reflejo de nuestros peores instintos.

Para maximizar los beneficios económicos, laborales y educativos de la IA, hay que aprender a crear prompts efectivos. Aquí algunos consejos:

La IA puede mejorar la eficiencia operativa, optimizar la gestión de recursos y fomentar la innovación en los procesos empresariales, lo que conlleva verdaderos beneficios económicos a largo plazo.

La IA en el ámbito laboral puede automatizar tareas repetitivas, mejorar la toma de decisiones y aumentar la productividad. Esto permite a los trabajadores centrarse en responsabilidades más creativas y estratégicas

En términos educativos la IA ofrece la capacidad de personalizar el aprendizaje, optimizar el tiempo de los docentes y mejorar los resultados educativos. Herramientas como los sistemas de tutoría inteligente permiten que los estudiantes reciban retroalimentación en tiempo real y ejercicios adaptados a su nivel de conocimiento.

Y todo esto nos ayudará a evitar los sesgos en la inteligencia artificial, que sin duda son un desafío crítico en el desarrollo y uso de sistemas inteligentes. A pesar de sus avances, la IA no es infalible: aprende de datos proporcionados por humanos y, como resultado, puede heredar y amplificar prejuicios existentes. Este fenómeno tiene implicaciones que pueden terminar por pegar en la equidad, la justicia y la confianza en la tecnología.

Siempre podremos encontrar un sesgo de datos, que ocurre cuando los datos utilizados para entrenar al modelo no representan adecuadamente a toda la población, también existe el sesgo Algorítmico, que surge cuando las decisiones en el diseño del algoritmo favorecen ciertos resultados.

Finalmente hay otro sesgo, que es el que están aplicando todos en sus peleas usando Grok para descalificarse: Sesgo de Interpretación, este llega cuando los desarrolladores o usuarios malinterpretan los resultados de la IA o aplican sus propios prejuicios.

Y así, como desde niños nos llenamos, o nos llenan, de ideologías, dogmas o así nosotros podemos hacerlo con la IA, tal como ocurre ahora con Grok a simple vista, pues se les está llenando de datos históricos sesgados, ya que está aprendiendo de datos del pasado, que pueden reflejar desigualdades históricas o prejuicios sociales.

Podría seguir, pero, mejor aquí me detengo, y cada quién que use la IA para lo que venga en gana, y aunque no es necesariamente que llegue Skynet, al rato no pregunten porque la IA les quitó el trabajo o los hizo a un lado, cuando la usaron para tonterías y solo subirse a un tren del mame, pero no entenderla y sacarle verdadero provecho.

Reportero interesado en la tecnología y los negocios. Edito el portal dariocelis.mx, escribo y conduzco en otros medios especializados en tecnología de la información. Me pueden localizar en mis redes sociales y mi correo electrónico adrian.campos@dariocelis.mx